过去的几十年,各大公司都在芯片上暗暗较劲:芯片涨价、GPU短缺、AI算力焦虑...就在大家盯着芯片迭代升级时,微软在悄悄做另一件事:用光重新定义计算。他们花了四年,用手机摄像头、Micro LED和透镜,拼出了一台模拟光学计算机(AOC)。如今,这个实验已经登上Nature,带来了一个足以颠覆GPU的未来想象。

光子登场:固定点搜索的秘密

几十年来,算力的故事几乎都写在硅片上:摩尔定律的加速、GPU的堆叠、能耗的焦虑。

可在英国剑桥,微软研究院的一支小团队走了一条完全不同的路——让光来算数。

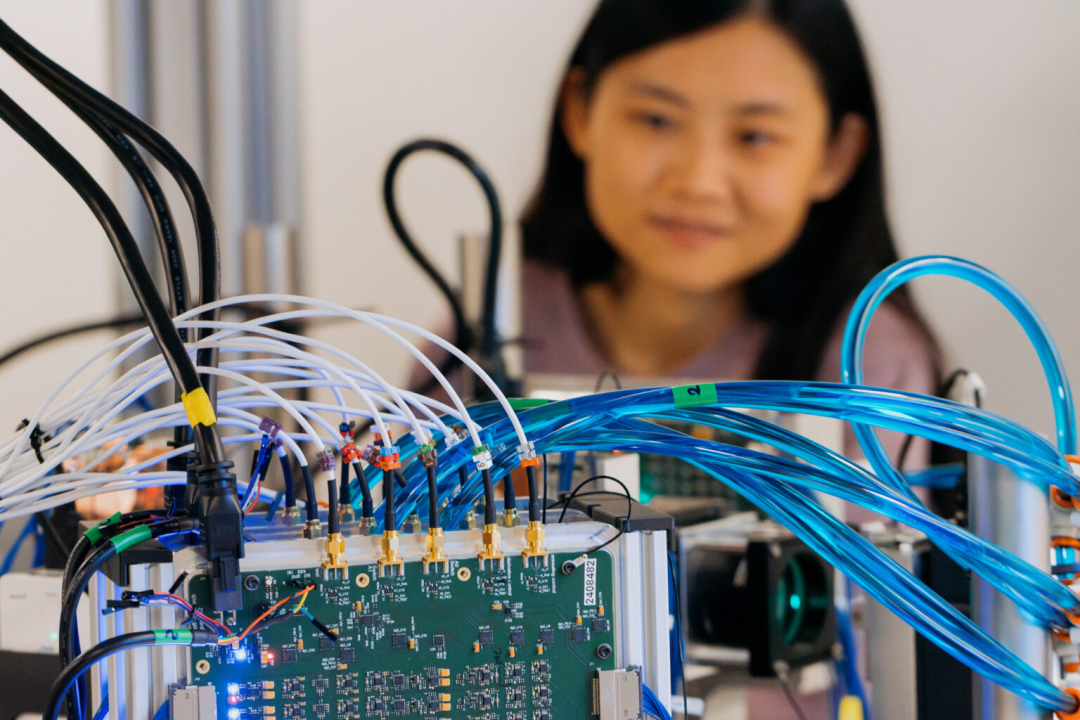

他们拼出了一台模拟光学计算机(AOC),材料一点也不稀有:Micro LED、光学镜头、还有来自手机的摄像头传感器。

看上去更像是一台实验室“组装机”,却打开了算力的另一种可能。

英国剑桥Microsoft Research实验室模拟光学计算机的详细图像。它是使用市售部件制造的,例如micro-LED灯和智能手机摄像头的传感器

其实,光学计算的设想早在20世纪60年代就被提出过,只是在当时受限于工艺,一直停留在理论层面。

如今,微软团队把它真正做了出来。

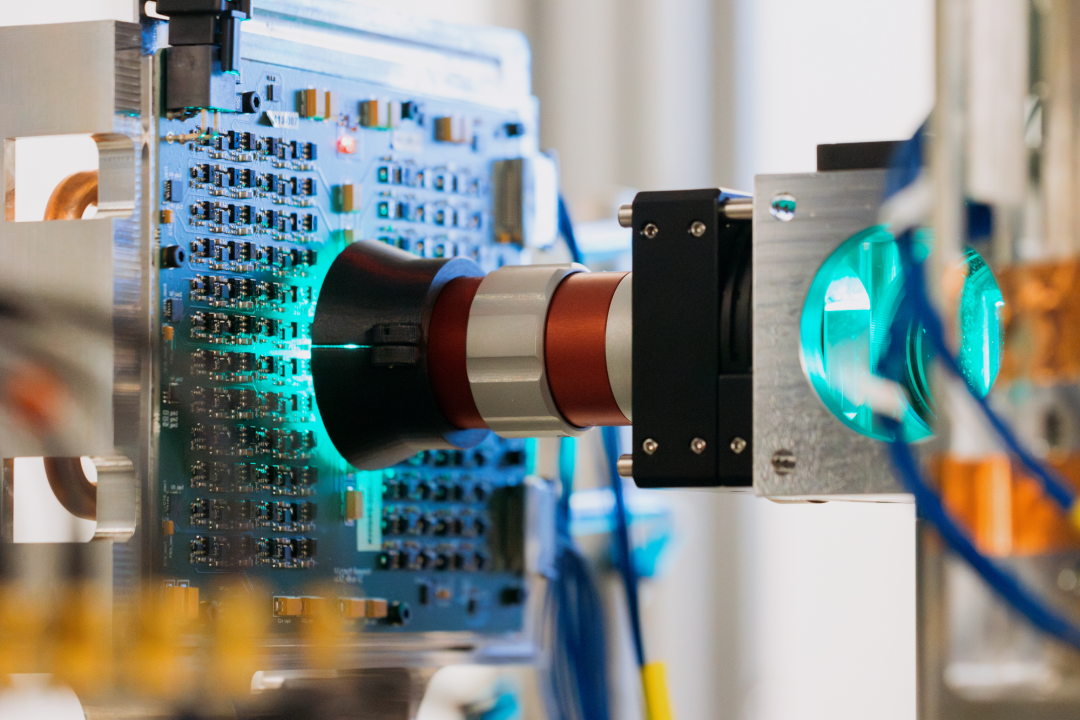

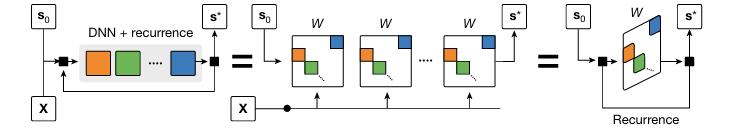

AOC真正的秘密不在这些零件,在于它的运行方式——固定点搜索。

它把光学和模拟电子电路放进一个循环回路:光学部分完成矩阵–向量乘法,电子部分处理非线性、加减法和退火操作。

每一次循环只需约20纳秒,信号在回路中不断迭代,直到收敛到一个稳定的“固定点”。

而这个固定点,就是问题的答案。

微软模拟光学计算机的内部结构:左上是整体示意,右下是光子与电子交替计算的链路

这种方式解决了两个长期困扰光学计算的难题:

一是避免了混合架构里高成本的数模转换,大幅降低能耗;

二是天然具备抗噪声的优势。

在迭代过程中,固定点就像一块磁铁,把答案牢牢吸住,不会轻易跑偏。

也正因为如此,AOC才能在同一平台上既处理优化问题,又能胜任AI推理。

四年前,这还是实验室里的一次冒险尝试。

如今,它已经登上Nature,第一次让光学计算不再是纸面概念,而是真正走进了公众视野。

CEO Satya Nadella在X上转发AOC研究,称其为“以更高效率解决复杂现实问题的新方法”,并强调该成果已发表于Nature

从银行到医院:AOC的第一次实战

微软团队最想让公众看到的的,不是炫技,而这项技术真的能用在现实世界里。

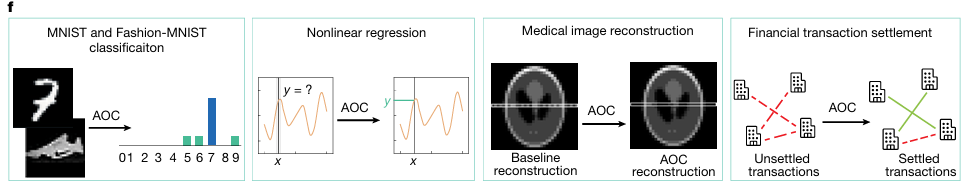

于是微软团队选择了两个最有代表性的场景——金融和医疗来进行验证。

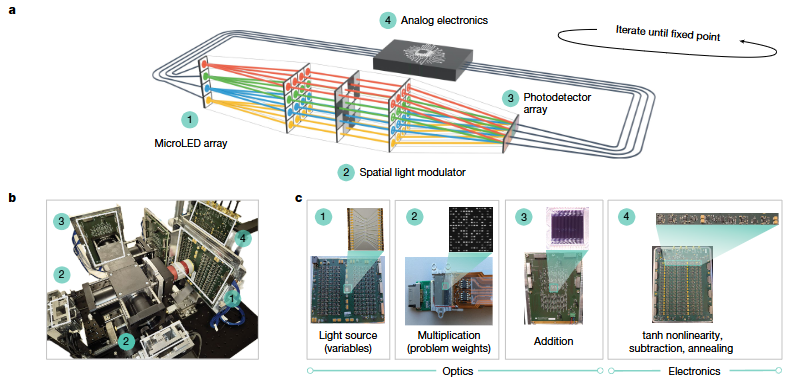

在金融领域,他们和巴克莱银行合作,把清算所每天都要面对的“货银对付”结算问题搬上了AOC。

传统清算所要在几十万笔交易中找到最高效的结算方式,这里团队先构建了一个缩小版:

46笔交易、37个参与方,转化为41个变量的优化问题。

结果显示,AOC只用了7次迭代就找到了最优解。

巴克莱的高级工程师Shrirang Khedekar也参与了论文,他评价说:

“我们相信有巨大的潜力可以探索。我们在金融行业也存在其他优化问题,我们相信AOC技术有可能在解决这些问题方面发挥作用。”

AI基础设施的研究

医疗领域同样展现了突破性。

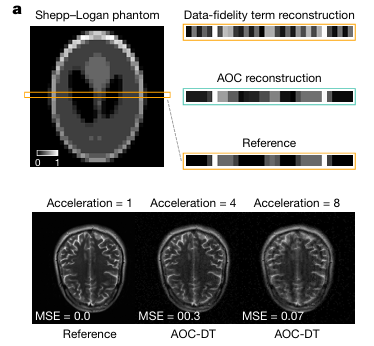

团队把MRI压缩感知成像重写成AOC能跑的优化问题,在硬件上先测试了一个32×32的Shepp–Logan phantom脑部切片图像,用64个变量就成功复原了原始图像。

更进一步,他们用数字孪生(AOC-DT)重建了一个包含20万变量的真实脑部MRI数据集。

Microsoft Health Futures的生物医学信号处理总监Michael Hansen直言:

“为了透明起见,我们现在不能在临床上使用它。这只是一个小规模的实验,但它给人的感觉是——如果真的做到全规模,后果将难以想象。”

他还设想,未来MRI原始数据可以直接流式传输到Azure上的AOC,再把结果实时回传到医院。

那将意味着,扫描时间或许能从30分钟缩短到5分钟,不仅大幅提升效率,也能让病人少受煎熬。

“我们必须找到方法来获取原始数据,并将其流式传输到计算机所在的地方。”

从金融到医疗,这两个案例释放出的信号非常明确:

AOC已经不再是实验室里的概念尝试,而是真正迈向对现实世界的改造。

AI新路径:GPU之外的可能性

而让研究团队最兴奋的突破,其实不是金融或医疗领域,而是人工智能。

一次实验室里的午餐交流,让事情出现了转折。

研究员Jannes Gladrow意识到:AOC的“固定点搜索”机制,天然适合那些需要反复迭代、最终收敛到平衡状态的平衡模型(比如深度平衡网络DEQ、现代 Hopfield网络)。

Deep Equilibrium Network(DEQ, 平衡模型) 的三种等价表示

在GPU 上,这类模型的算力消耗极大,而在AOC上,它们几乎就是“为光子而生”。

于是团队尝试把一些简单的AI任务映射到AOC。结果很快出现:

在MNIST和Fashion-MNIST分类任务上,AOC与数字孪生(AOC-DT)的结果几乎99%对齐;

在非线性回归任务中(如拟合高斯曲线、正弦曲线),AOC同样表现稳定,曲线几乎与仿真结果重合;

通过时间复用技术,研究人员还把硬件扩展到等效4096权重的规模,证明它不仅能跑“小玩具”,而是具备进一步放大的潜力。

AOC在MNIST分类和非线性回归(高斯曲线、正弦曲线)上的实验结果。

这些实验让人看到一条GPU之外的新路径。

微软研究人员认为,未来的大语言模型在推理时最吃力的部分——状态跟踪,或许正好可以交给 AOC。

想象一下,如果复杂的推理过程不再依赖耗能巨大的GPU,而是交由光学计算机完成,所需能耗可能会降低两个数量级。

在一个为算力能耗焦虑的时代,这样的结果无疑点燃了行业的想象力。

长跑与愿景:算力的另一条赛道

微软研究团队很清楚,现在的AOC还只是个原型,离真正的商用还有一段陡坡。

它现在能处理的权重规模是几百级别,但研究人员已经画出了扩展路线图:

未来通过模块化扩展,每个模块可以支持约400万权重。

几十到上千个模块拼接,就能把整体规模推到0.1–20 亿权重。

更震撼的,是能效对比。

团队估算,成熟版本的AOC有望达到500 TOPS/W(约2fJ/操作),而当前最先进的GPU(如NVIDIA H100)大约只有4.5 TOPS/W。

这意味着能效差距高达两个数量级。

正如项目研究员Jannes Gladrow所说:

“AOC带来的最重要特性,是我们估算它的能效能提升约一百倍。光凭这一点,在硬件领域几乎是前所未闻的。”

换句话说,在未来的大模型推理任务中,如果GPU是“油老虎”,AOC就可能成为“新能源汽车”。

不仅能跑,而且能以极低的能耗持续运行。

群星闪耀:拼出光学计算机的人

这台用光来思考的机器背后,不是某个天才的孤军奋战,而是一群跨学科研究者的集体智慧。

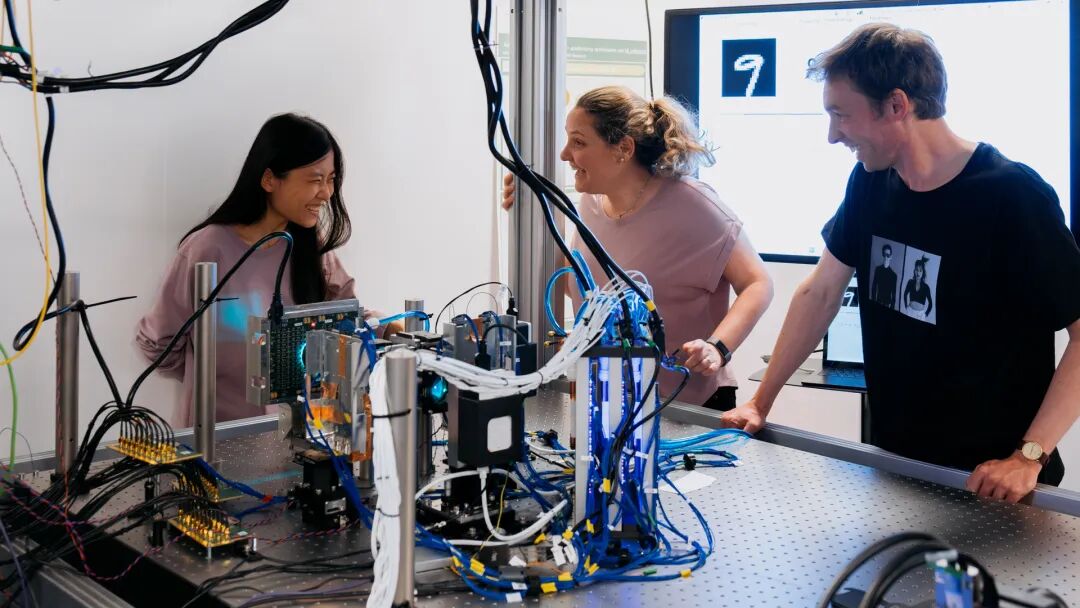

Francesca Parmigiani,是微软剑桥研究院的首席研究经理。

她带领团队把一个在学术圈流传半个世纪的概念变成真实硬件,并坚持要把“数字孪生”开放出来,让更多研究者能参与实验。

她常说,AOC 不是一台通用计算机,而是一台能在关键场景跑出新可能的“光学加速器”。

Jannes Gladrow是团队里的机器学习专家。

一次非正式的午餐交流上,他突然意识到AOC的固定点机制与平衡模型天然契合。

这一灵感让AOC不再局限于优化问题,而是第一次与AI紧密结合。

他把模型映射到硬件,跑出了手写数字分类与函数回归的结果,也因此打开了一条GPU之外的道路。

医疗应用的火花来自Michael Hansen。

他把MRI数据重建引入实验,并设想未来的扫描原始数据可以直接流向AOC,再实时回传到医院。

这种跨领域的设想,让光学计算机与现实世界真正接轨。

而在实验室里,忙着搭建原型的身影常常是担任首席研究员的Jiaqi Chu。

她负责把微型LED、透镜和传感器拼装在一起,让那些“光学数学”在现实设备上运行起来。

Jiaqi Chu、Francesca Parmigiani和James Clegg

她的工作证明了这不是一台只能存在于论文里的幻想机,而是一台可以用现成零件拼出的新型计算机。

正是这些人的交汇,让光学计算机从概念走向现实,从银行清算到 MRI,再到 AI 的未来路径,拼出了算力世界里一条全新的可能。

四年前,一个小团队用手机摄像头和LED灯拼装出一台怪模怪样的机器。

今天,它登上了Nature,证明自己能跑金融和医疗的难题,还能打开AI 的新路径。

研究负责人Hitesh Ballani说,他们的目标是让AOC成为未来AI基础设施的一部分。

这场算力的长跑,或许已经开辟出一条全新的赛道。