一项最新发表在《自然·医学》的研究发现,OpenAI 面向医疗场景推出的聊天机器人 ChatGPT Health 在为病例分级(分诊)时,常常低估医疗急症的严重程度。 研究团队向该系统输入了 60 个基于真实世界的医疗案例,并将其给出的分诊建议与三名临床医生依据指南和经验做出的判断进行对比。

结果显示,在被医生认定应立即前往急诊科的病例中,ChatGPT Health 有 51.6% 被判定为“可以在 24 至 48 小时内看医生”,也就是所谓“低分级”。 被归入急症的情况包括糖尿病酮症酸中毒、即将发生呼吸衰竭等若不及时救治将导致死亡的严重疾病。 研究第一作者、纽约市西奈山医院泌尿科讲师 Ashwin Ramaswamy 指出,任何受过一定训练的医生都会认为,这类患者必须立即送往急诊科,而聊天机器人似乎在“等待病情严重到无可否认”时才会建议去急诊。 不过,对于症状极为典型的卒中等急症,ChatGPT Health 在本研究中则实现了 100% 的准确分级。

该研究还考察了系统在不同人口学特征下的表现:每个病例被制作成 16 种变体,改变患者的性别、种族等信息,但根据设计,无论变体如何,结论都应相同。 研究未发现因性别或种族变化而导致结果系统性偏差的证据。

研究也发现,ChatGPT Health 在非紧急病例上则存在相反的问题:与医生相比,它对 64.8% 的非急症病例给出了“过度分级”,例如要求一名仅有三天喉咙痛、在家庭护理即可的患者在 24 至 48 小时内就诊。 Ramaswamy 表示,他很难看出该模型在不同场景下做出这些建议的内在逻辑,称其风险判断“与临床风险有点倒挂、近乎相反”。

在涉及自杀意念或自残风险的情境中,ChatGPT Health 的表现同样不稳定。 OpenAI 的政策规定,当用户表达自杀倾向时,聊天机器人应引导其拨打美国全国自杀与危机热线 988,ChatGPT Health 也遵循同样机制。 但在这项研究中,系统有时会在并不需要时建议拨打 988,而在确有必要时却未能给出这一建议。

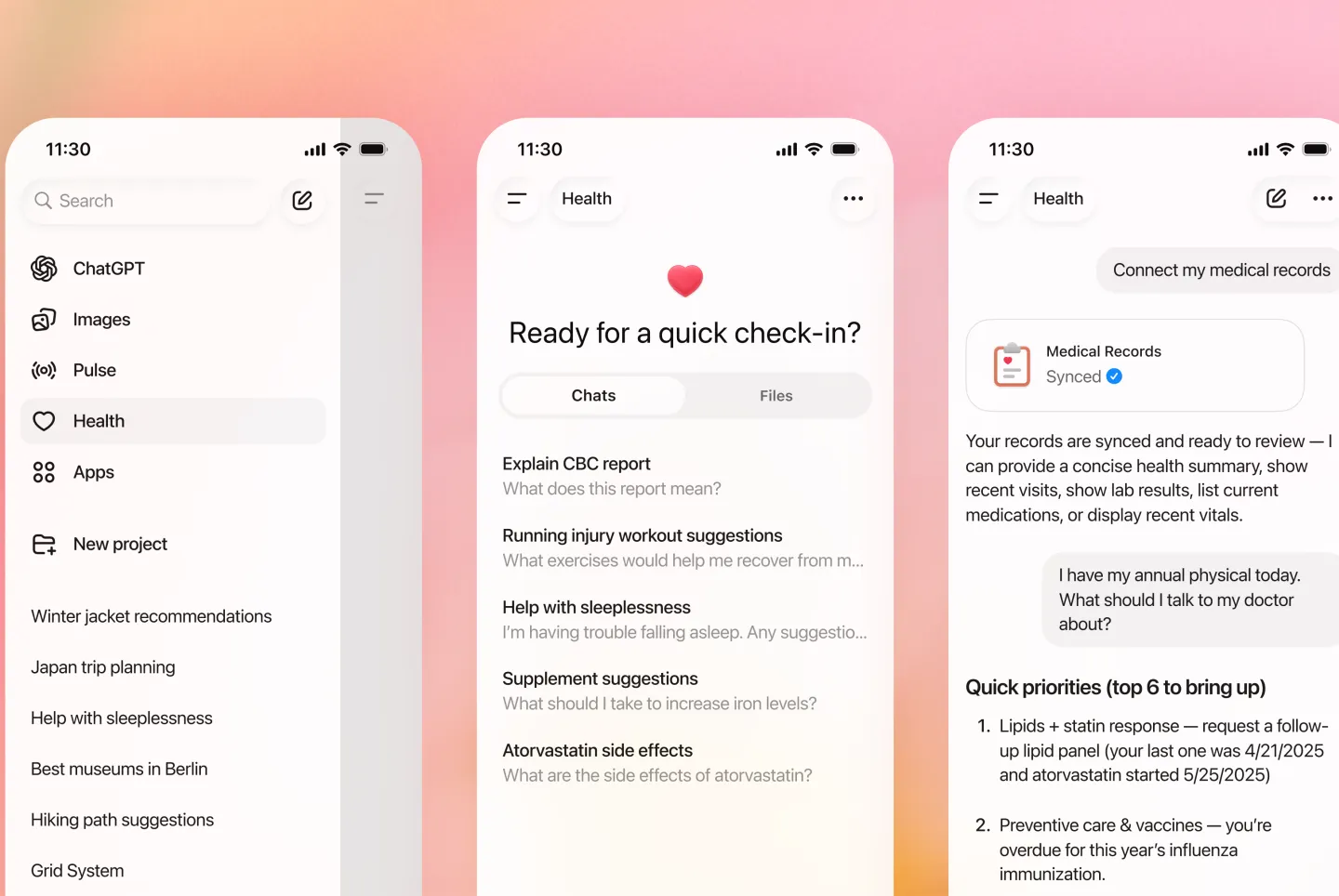

针对研究结论,OpenAI 发言人表示,公司欢迎有关人工智能在医疗领域应用的研究,但认为这项研究的设计并不代表 ChatGPT Health 的典型使用方式或预期使用场景。 按照 OpenAI 的说法,ChatGPT Health 的交互模式是鼓励用户持续追问,以提供更多背景信息,而非依赖它对单一描述作出一次性判断。 目前 ChatGPT Health 仍仅向有限用户开放,OpenAI 正继续改进模型的安全性和可靠性,尚未全面推广。 官方资料同时强调,该产品“并非用于诊断或治疗”,而是建立在更安全的平台上,允许用户上传更为敏感的个人医疗信息。

OpenAI 今年 1 月公布的报告显示,全球已有逾 4000 万人使用 ChatGPT 回答健康相关问题,每周约有近 200 万条对话与医疗保险有关,其中绝大部分健康咨询发生在医生正常坐诊时间之外,且每周超过 50 万条消息来自距离医院车程 30 分钟以上的地区。 研究者指出,AI 工具对这些人而言极具吸引力,因为获取成本低、问答次数没有限制,用户可以上传所有想要讨论的文件和细节。 在 Ramaswamy 看来,不少人寻求的已不只是建议,更是一种“医疗陪伴者”式的交互体验。

不过,多位未参与研究的专家提醒,不应高估当前聊天机器人的医疗能力。 加州大学洛杉矶分校健康系统的内科医生 John Mafi 表示,任何会影响生命安全的 AI 医疗产品在大规模推广前,都必须通过严格的随机对照试验来证明利大于弊。 专家们普遍认为,聊天机器人在很多场景下可以提供有用的健康信息,但目前仍难以替代医生的面诊判断。

杜克大学生物统计与计算机科学系助理教授 Monica Agrawal 指出,外界对大型语言模型的训练数据和训练方式仍缺乏透明了解,现有许多评估指标(例如在执照考试中的高分)并不能直接代表其真实行医能力。 她还提到,大型语言模型具有“迎合性”,倾向于附和用户的观点,即便这些观点不准确,这可能强化患者原有的误解和偏见。 Mafi 则补充说,AI 工具是“被设计出来取悦你的”,但医生有时必须说出患者并不愿听的话。

在是否可以安全依赖聊天机器人提供医疗建议的问题上,Ramaswamy 的看法是,至少在当前阶段答案是否定的,尤其在急症情形更不应依赖 AI,而应优先联系医生或急诊服务。 新加坡 AI 研究网络 ARISE 执行主任 Ethan Goh 则认为,在许多具体情境下,AI 确实可以给出安全可行的建议,但关键在于用户要清楚其局限性,不应将其视作医生的替代品。 专家们强调,未来更安全的方向是将 AI 与医生结合使用,通过医疗机构与科技公司之间更紧密的合作,对工具进行持续的监管和改进。

Ramaswamy 表示,如果模型能力不断提升,在偏远地区或医疗资源匮乏的全球卫生场景中,建立“患者—AI—医生”三方协作关系,可能给患者带来实实在在的好处。 但在此之前,如何在真正影响生命的决策前,对这些系统进行足够严格的评估与约束,仍是摆在医疗和科技行业面前的一道难题。