Rambus 宣布推出全新的 SOCAMM2(Small Outline Compression Attached Memory Module,小型轮廓压缩附加内存模块)芯片组,旨在为 AI 服务器平台提供基于 LPDDR5X 的低功耗高性能内存模块支持。

SOCAMM2 是 Rambus 围绕 LPDDR 技术打造的服务器内存模块产品路线图中的首款芯片组,体现了该公司与产业伙伴在新型内存架构上的持续合作,以适配不断演进的 AI 数据中心工作负载需求。这一全新产品家族补充并扩展了 Rambus 现有的内存接口芯片布局,使其覆盖所有符合 JEDEC 标准的 DDR5 与 LPDDR5 内存模块。

Rambus 指出,AI 推动下的数据中心工作负载正在迅速多样化和扩张,系统设计因此愈发强调针对性优化,包括功耗效率、算力密度、形态尺寸以及内存可扩展性等关键指标。基于 LPDDR 技术的 SOCAMM2 内存模块,正成为应对这些挑战的一种创新架构路径:在模块化、可维护且节省板级空间的封装形态下,实现高性能与低功耗的结合。

新发布的 Rambus SOCAMM2 芯片组,旨在为符合 JEDEC 标准的 SOCAMM2 服务器内存模块提供关键的控制、遥测(telemetry)以及电源管理等功能,以支撑在高要求 AI 服务器环境中的稳定运行。Rambus 内存接口芯片事业部高级副总裁兼总经理 Rami Sethi 表示,AI 系统架构正在快速演进,内存已成为性能、能效与可扩展性的核心支撑要素之一。他称,SOCAMM2 标志着在下一代 AI 服务器中引入模块化、低功耗且高性能内存的重要一步,这一芯片组也是基于 LPDDR 的服务器模块芯片家族的起点,Rambus 正在积极开发下一代解决方案,以支撑未来 AI 基础设施的演进。

存储厂商也将 SOCAMM2 视作 AI 服务器内存生态的重要方向。Micron 云端内存产品事业部副总裁兼总经理 Praveen Vaidyanathan 表示,SOCAMM2 是实现高效、可扩展、面向 CPU 连接的下一代 AI 服务器内存的关键一步。他指出,在 AI 不断冲击算力与功耗上限的背景下,产业迫切需要围绕 LPDDR 级别服务器内存建立完善的生态。Rambus 推出的这一高度集成芯片组,有助于推动 SOCAMM2 在未来 AI 系统设计中的普及与演进。

市场研究机构 IDC 记忆体半导体副总裁 Soo Kyoum Kim 则认为,随着 AI 工作负载持续挑战数据中心在功耗、带宽与密度方面的极限,SOCAMM2 等内存架构代表了在性能与能效之间寻求平衡的重要演进方向。他强调,像 Rambus 这样的生态参与者所做的贡献,对推动基于 LPDDR 的内存真正渗透进 AI 服务器领域至关重要。

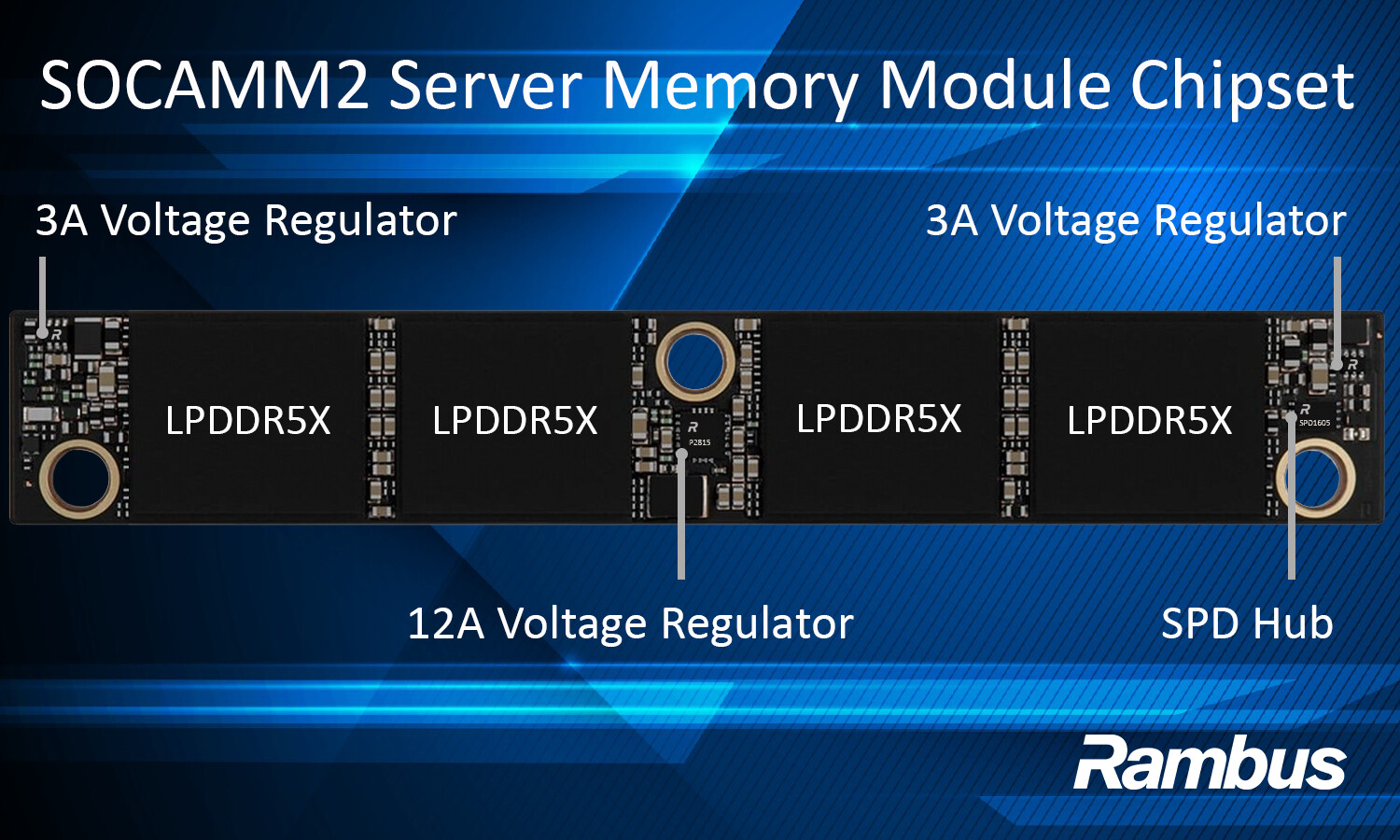

在具体形态上,SOCAMM2 替代了传统焊接在主板上的 LPDDR 内存方案,以可插拔、可升级的模块设计,兼顾 LPDDR 的高能效与数据中心级可维护性。Rambus 的 LPDDR5X SOCAMM2 芯片组可支持 LPDDR 架构服务器内存模块在最高 9.6 Gb/s 速率下实现可靠且节能的运行,芯片组集成的功能包括:用于模块识别、配置与遥测的 SPD Hub,以及本地高效电源转换的 12 安培与 3 安培电压调节模块(VR)。

据介绍,Rambus 此次发布的 SOCAMM2 芯片组,旨在为 AI 数据中心日益精细化、差异化的内存需求提供一个面向未来的模块化基础,为后续更高带宽、更大容量的 LPDDR 服务器内存方案铺路。